【導讀】自特斯拉FSD V12率先將端到端大模型引入量產車以來,"規則驅動"向"數據驅動"的范式轉移已成為行業共識——動作是否流暢、能否應對長尾場景、決策是否擬人化,取代了傳統的功能清單,成為衡量智能駕駛體驗的新標尺。在這場由方法論革新引發的浪潮中,蔚來經歷了從規則構建到數據驅動的艱難轉身,如今又以"世界模型+閉環強化學習"的全新架構重新出發。當技術路線的迷霧逐漸散去,蔚來新版NOA能否憑借這套端到端強化學習體系,在復雜的中國城市場景中實現真正的"擬人化"突破,重回行業第一梯隊?

Part 1、蔚來的輔助駕駛的轉型

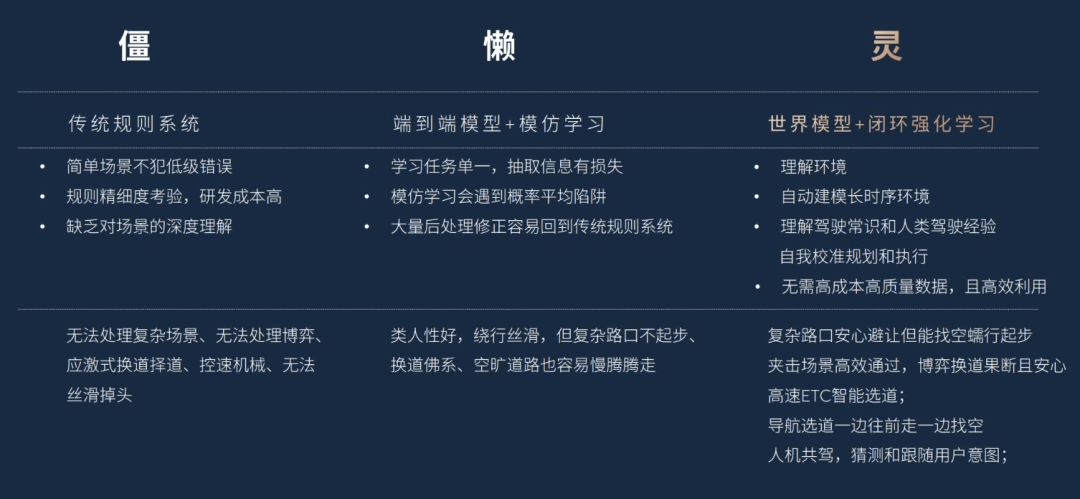

在中國智能駕駛的迭代中,特斯拉提出的端到端一個拐點,在出現了這個技術變化之后,城市NOA中擬人化變成了非常重要的評價點,規則味比較重,是落后的標志。

體驗上主要是動作機械、加減速轉向不流暢、卡頓,無法應對各種Corner case, FSD V12、V13 V14 的一路發展,在方法論上特斯拉是一路牽引整個行業的發展。

在蔚來的第一代車型,是圍繞規則來構建的輔助駕駛,確定變道距離、確定的加減速邏輯、確定的安全邊界。在中國復雜的城市場景復雜度下并不完善。

從規則開始,蔚來花了很多時間來切換技術路線。轉向數據驅動過程中,用模型把規則“壓縮”進參數里,讓系統通過學習大量真實駕駛數據,自己學會如何變道、擇道。

數據驅動的問題是,同一個場景下,人類的行為并不一致。在道路上,人的習慣和交通流量都會影響決策,從結果來看,能看到不同的駕駛員在不同的位置換道,模型學到的是一種“折中選擇”,為了安全往往選擇保守跟隨,或者說要真正實現“高效、主動通行”,伴隨著不少的小事故。

為了平衡風險,引入更強的地圖和路徑引導、采集專家駕駛數據并減少行為差異,或者加回一部分規則邏輯。這些都是中國在這段時間走過的路。

Part 2、蔚來新版的NOA

蔚來世界模型在2026年的目標是回到行業的數一數二的位置。方法是對智能輔助駕駛全研發迭代方法進行調整,引入世界模型 + 閉環強化學習的模式。

這也是以端到端系統為基礎,核心分為三步:

基礎行為習得:通過學習海量人類駕駛行為,讓模型形成駕駛答題本,標記各類場景下的行為概率,習得駕駛基本肌肉記憶;

環境深度理解:模型從當前時刻出發,預測自身下一步多種動作,并推演不同動作對周圍環境的影響,及環境變化對自身行為的反作用,實現長達數分鐘的長時序思考,這是核心運行機制;

閉環強化校準:在虛擬「駕駛考場」中,通過數上億輪專業場景訓練和評估反饋,讓模型精準理解「好行為與差行為的區別」,基于駕駛常識和人類經驗校準行為「答題本」,這一過程即為閉環強化學習。

這里要回答幾個關鍵問題,強化學習到底解決了什么問題?這是給結果打分,讓模型自己學,模型輸出行為后,系統會根據結果給予正向或負向反饋,讓模型在反復嘗試中學會什么是“更優解”,過程本身就是一種自我校正。

在實際訓練中,通過獎勵評估機制直接給行為打分;利用真實人類行為反饋,反推出獎勵信號, 模型在其中會經歷自監督學習,逐步形成穩定的決策偏好。

舉例來說先構建一個仿真環境,在其中設定一條“目標線”,車輛如果順利完成左轉并線,就得到獎勵;完成得越快、越平順,獎勵越高。

在此基礎上,只保留少量必要的約束,比如壓實線會被扣分,但不再寫復雜規則。在哪個位置變道、如何跨越三條車道、怎樣兼顧效率與安全,全部交給模型在仿真環境中自行探索。

在這樣的基礎上不需要為每一個特殊路口單獨采集數據。只要仿真環境中構建出“相似結構”的場景,模型就能遷移能力,避免了為成百上千個復雜路口重復采數據的低效過程。目標簡單、約束少,讓模型自己找路徑。

規則一旦極簡,反而更穩定、更通用。

Part 3、實際的體驗

在我們的實際體驗中,換道策略、導航選道,在道路中的剎車控制都有很大的改善。

偏航和復雜路口,是需要“提前判斷”的場景,NOA的系統在快到路口才反應一般感受會很差或者就錯了(要么壓實線要么錯了),需要在更早的階段就意識到,模型會提前接收到“未來懲罰”,從而主動調整決策。

實際上,在擬人化抉擇上,比如判斷安心感充足時果斷切入,不魯莽擠壓旁車;目標車道擁堵時,緩慢前行并持續尋找變道空隙;通過蠕行尋找通行空隙,這些行為都是挺大的改善。

結論

蔚來的探索揭示了一個核心趨勢:智能駕駛的下半場競爭,本質上是"學習效率"與"泛化能力"的較量。世界模型賦予系統長時序推演能力,讓車輛能夠"預見"而非"反應";閉環強化學習則通過虛擬考場中的億級輪次訓練,使模型在極少規則約束下自主尋優,實現從"學會開車"到"開好車"的躍遷。實際體驗中換道策略的果斷、復雜路口的提前預判、擁堵場景下的蠕行尋隙,都是這一技術路線落地的直觀印證。